Die Welt des Audioformats hat in den letzten Jahren einen bemerkenswerten Wandel erlebt, insbesondere mit der Einführung von Technologien wie Dolby Atmos. In diesem Zusammenhang taucht eine entscheidende Frage auf: Kanalbasiertes vs. objektbasiertes Audioformat. Im kanalbasierten Format werden Audiosignale vordefinierten Lautsprechern zugeordnet, was unabhängig von der Wiedergabeumgebung zu einer festen Kanalzuweisung führt. Auf der anderen Seite ermöglicht das objektbasierte Audioformat eine flexiblere und präzisere Steuerung der Klangwiedergabe, indem es Metadaten zur genauen Positionierung der Audiosignale im Raum verwendet. In diesem Artikel werden wir einen genaueren Blick auf die Unterschiede zwischen diesen beiden Ansätzen werfen und herausfinden, wie sie die Art und Weise, wie wir Audio erleben, grundlegend verändern.

Bei einem kanalbasierten Format sind die Kanäle einer Audiodatei vordefinierten Lautsprechern zugewiesen. Die zwei Audiospuren einer Stereodatei werden so zugeteilt, dass die erste Audiospur auf dem linken Lautsprecherkanal und die zweite Audiospur dem rechten Lautsprecherkanal liegt. Daran ändert sich nichts, egal, auf welchem Endgerät diese Datei abgespielt wird. Gleiches gilt auch für gängige Surroundformate wie 5.1 oder 7.1. Eine 5.1‑Audiodatei beinhaltet sechs Audiospuren: L, R, C, LFE, Ls und Rs. Schon durch die Bezeichnung der einzelnen Spuren ist die Zuordnung zu den Lautsprecherkanälen definiert. Wird eine 5.1‑Datei auf einem System wiedergegeben, das nicht dieser Anordnung entspricht und beispielsweise nur über eine Stereokonfiguration mit linkem und rechtem Kanal verfügt, so sind lediglich der linke und rechte Kanal hörbar. Die Spuren C, LFE, Ls und Rs werden ignoriert und bleiben stumm.

Bereits vor der Einführung von Dolby Atmos gab es Audioformate, wie das Format Auro-3D, die mit Lautsprechern an der Decke das Gefühl erzeugten, umhüllt vom Klang zu sein. Diese waren jedoch kanalbasiert, sodass für jedes System eine passende Datei, mit der entsprechenden Anzahl an Kanälen generiert werden musste.

Diese Art von fixierten Mehrkanalanordnungen macht sich auch Dolby Atmos zunutze. Dort werden sie als Bed bezeichnet. Ein Bed ist dabei immer kanalbasiert und kann in beliebiger Konfiguration, allerdings höchstens bis 7.1.2 auftreten.

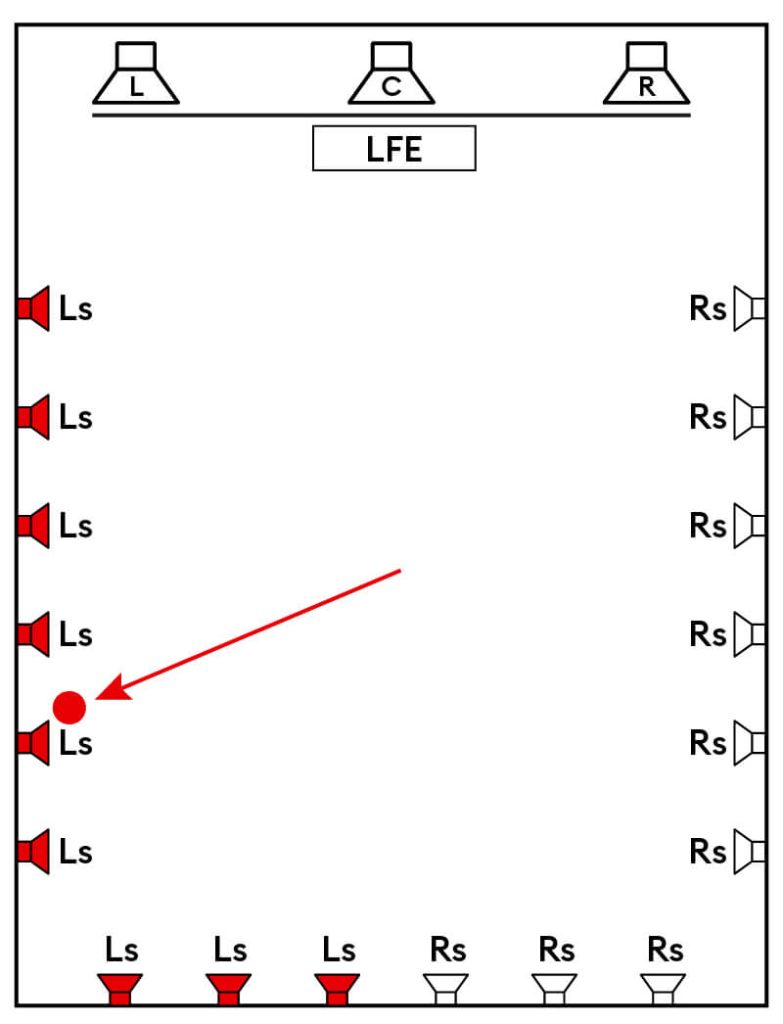

Die folgende Grafik zeigt die Signalverteilung in einem Kinosaal mit einem 5.1 Soundsystem.

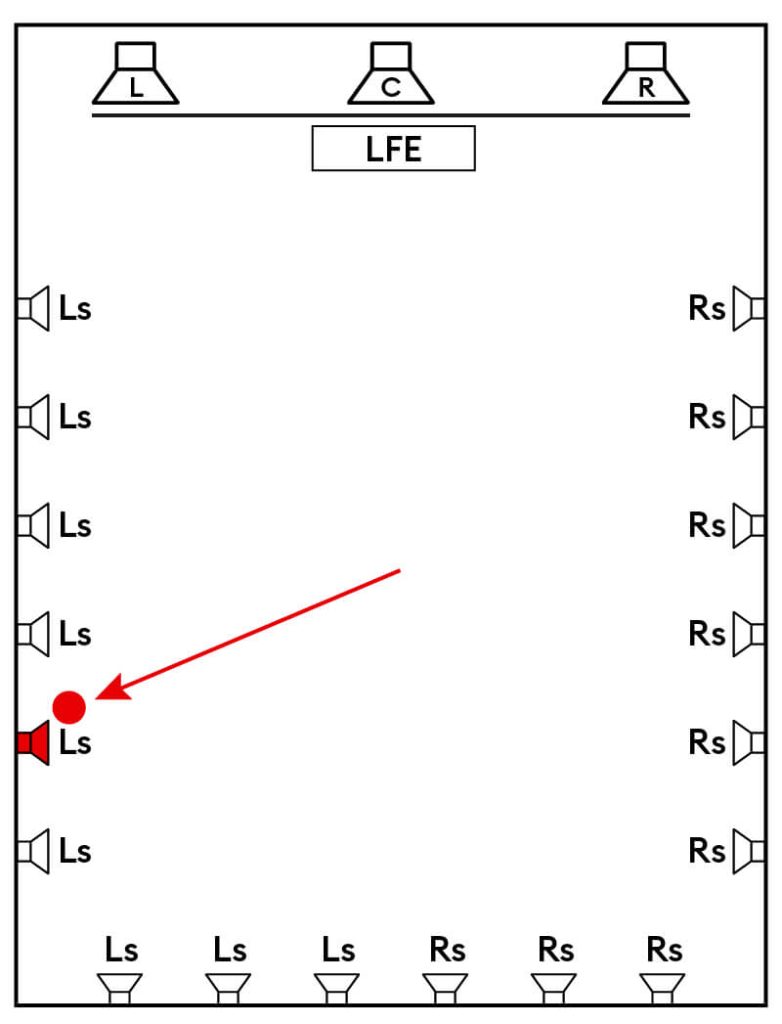

Wie zu erkennen ist, werden die 18 Surroundlautsprecher in zwei Hälften unterteilt – in Left-Surround und Right-Surround. Beide Surroundsignale werden gleichermassen über neun Lautsprecher wiedergegeben. Dies lässt eine konkrete Lokalisierung einzelner Signale im Surround schwer zu. Um dies zu ermöglichen, bietet Dolby Atmos neben den Beds auch sogenannte Objekte. Ein Objekt ist dabei ein Audiokanal, der zusätzlich noch Metadaten in Form von X‑, Y- und

Z‑Koordinaten enthält, was eine exakte Positionierung im Raum möglich macht. Dadurch können Lautsprecher, die zuvor nur innerhalb eines Beds funktioniert haben, einzeln angesteuert werden, was eine schärfere und genauere Lokalisierbarkeit von Signalen ermöglicht.

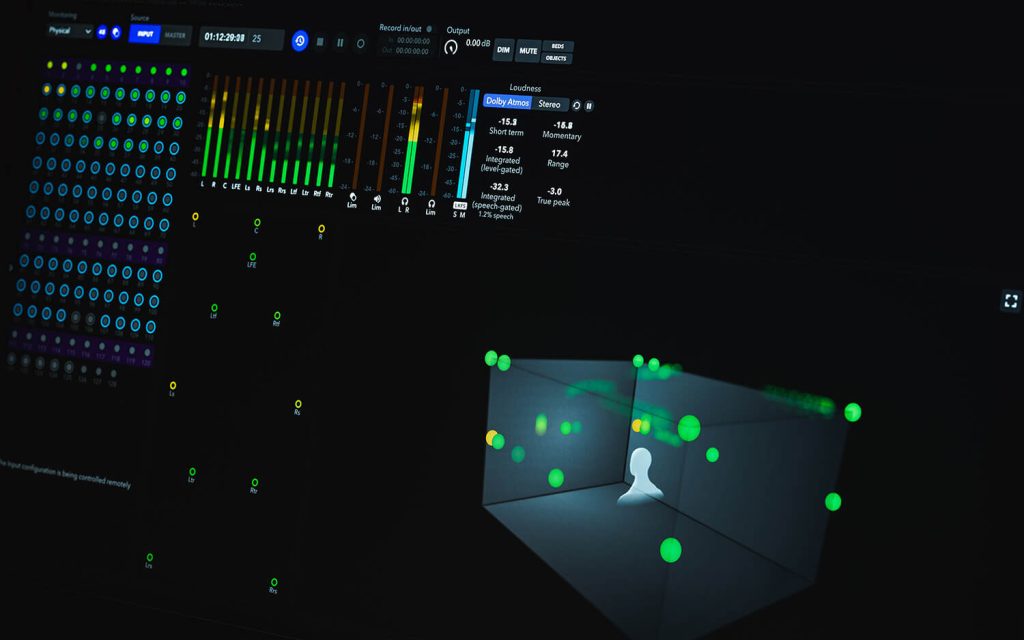

Die Entscheidung, aus welchen Lautsprechern ein Signal erklingt, wird erst am jeweiligen Abspielort getroffen. Bis dahin sind alle Audiokanäle und die entsprechenden Metadaten in einem Container verpackt. Da es keine vordefinierte Zuordnung zu Lautsprechern gibt, ist dieses Konzept beliebig skalierbar und ermöglicht die Wiedergabe auf unterschiedlichen Systemen gleichermassen.

Um eine Dolby Atmos Datei abzuspielen, wird ein dazu fähiges Gerät benötigt, das die Lautsprecherkonfiguration am jeweiligen Ort kennt. Das Gerät, das die Dolby Atmos Datei dekodiert, wird von Dolby auch als Renderer bezeichnet. Es entpackt die Signale und platziert sie anhand ihrer Metadaten im Raum. Die vektorielle Richtung, aus der ein Klang abgebildet wird, ist dementsprechend in jedem Raum gleich. Die physischen Lautsprecher, aus denen das Signal wiedergegeben wird, sind von der Lautsprecherkonfiguration abhängig und unterscheiden sich von Raum zu Raum. Die folgenden Abbildungen veranschaulichen den Unterschied zwischen der Wiedergabe eines Signals in einem 5.1‑Bed und als Objekt. Wird das Signal in einem Bed platziert, wird es über das gesamte Lautsprecher-Array gleichermassen wiedergegeben. Bei der Verwendung als Objekt erklingt das Signal hingegen nur aus einem Lautsprecher.